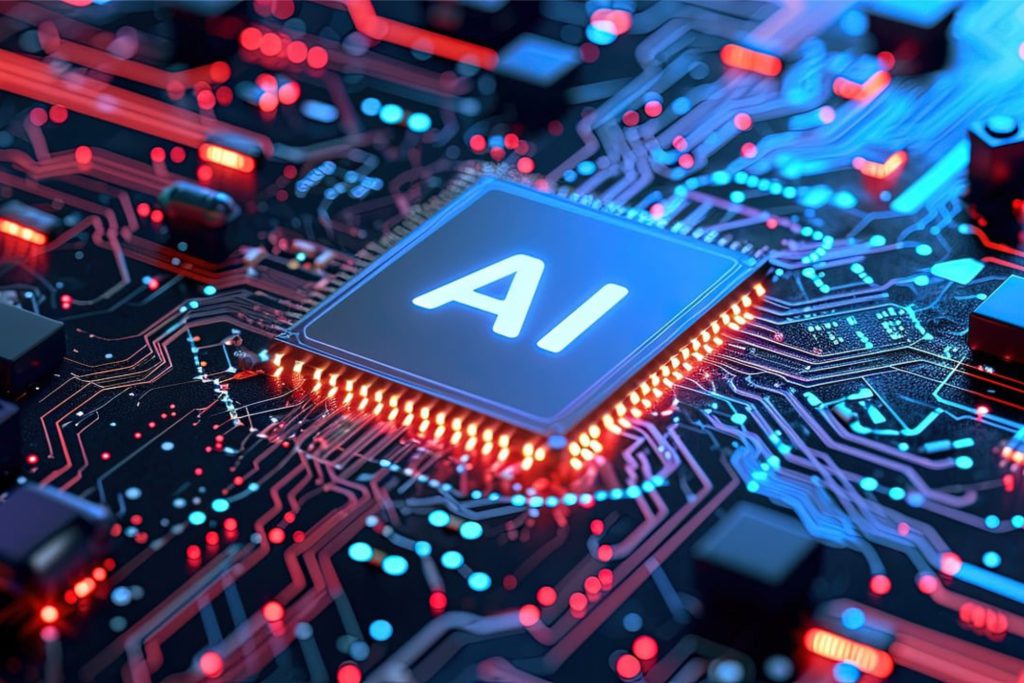

Najnowszym celem OpenAI jest zapewnienie, że superinteligentna sztuczna inteligencja nie zagrozi nam wszystkim

Firma tworzy zespół, który będzie badał możliwe sposoby powstrzymania sztucznej inteligencji, która jest inteligentniejsza od ludzi.

Nie jest jasne, czy sztuczna inteligencja pewnego dnia dorówna i przewyższy ludzką inteligencję, ale twórca ChatGPT, OpenAI, już zaczyna badać sposoby zapobiegania tak zwanej “superinteligentnej sztucznej inteligencji” przed zbuntowaniem się i potencjalnym unicestwieniem nas wszystkich.

Zagrożenie to może brzmieć jak fabuła filmu science-fiction. Jednak OpenAI ostrzegło dziś przed ryzykiem związanym z superinteligentnymi systemami sztucznej inteligencji – lub komputerami, które będą znacznie mądrzejsze od ludzi.

“Superinteligencja będzie najbardziej wpływową technologią, jaką ludzkość kiedykolwiek wynalazła i może pomóc nam rozwiązać wiele najważniejszych problemów na świecie” – napisała firma w poście na blogu. “Ale ogromna moc superinteligencji może być również bardzo niebezpieczna i może doprowadzić do pozbawienia ludzkości praw, a nawet do jej wyginięcia”.

OpenAI przewiduje, że superinteligentne systemy AI pojawią się w ciągu “tej dekady”. Jest to dość odważna prognoza, ponieważ aplikacja ChatGPT firmy nie jest uważana za sztuczną inteligencję ogólną (AGI) zdolną do myślenia na poziomie ludzkim.

Zamiast tego ChatGPT działa jako duży model językowy podobny do autouzupełniania, który może odtwarzać odpowiedzi podobne do ludzkich, ale bez pełnego zrozumienia znaczenia słów. W związku z tym może czasami wymyślać odpowiedzi, które są oczywiście błędne lub nie potrafią uchwycić podstawowej logiki. Może więc wydawać się dziwne, że OpenAI już teraz przewiduje nadejście superinteligentnej sztucznej inteligencji. Niemniej jednak laboratorium w San Francisco chce się przygotować.

“Obecnie nie mamy rozwiązania do sterowania lub kontrolowania potencjalnie superinteligentnej sztucznej inteligencji i zapobiegania jej zbuntowaniu się” – powiedziała firma. “Nasze obecne techniki dostosowywania sztucznej inteligencji, takie jak uczenie się przez wzmacnianie na podstawie informacji zwrotnych od ludzi, opierają się na zdolności ludzi do nadzorowania sztucznej inteligencji. Ale ludzie nie będą w stanie niezawodnie nadzorować systemów sztucznej inteligencji znacznie mądrzejszych od nas”.

W rzeczywistości superinteligentna sztuczna inteligencja mogłaby reagować i wydawać polecenia znacznie szybciej niż jakikolwiek człowiek, co być może uniemożliwiłoby jej kontrolowanie w czasie rzeczywistym. Oznacza to, że OpenAI potrzebuje “nowych przełomów naukowych i technicznych”, aby powstrzymać hipotetyczny system sztucznej inteligencji. W tym celu firma tworzy nowy zespół zajmujący się “badaniami nad superustawieniami” i przeznacza na ten cel 20% zasobów obliczeniowych OpenAI.

Obecne podejście zespołu skupi się na stworzeniu “zautomatyzowanego badacza dopasowania na poziomie zbliżonym do ludzkiego” lub czegoś, co zasadniczo jest programem sztucznej inteligencji zaprojektowanym do – jak na ironię – nadzorowania przyszłego superinteligentnego komputera. “Możemy następnie wykorzystać ogromne ilości obliczeń, aby skalować nasze wysiłki i iteracyjnie dostosowywać superinteligencję” – powiedziała firma.

Celem OpenAI jest “rozwiązanie podstawowych wyzwań technicznych związanych z dostosowaniem superinteligencji” w ciągu najbliższych czterech lat. “Chociaż jest to niezwykle ambitny cel i nie mamy gwarancji, że odniesiemy sukces, jesteśmy optymistami, że skoncentrowany, wspólny wysiłek może rozwiązać ten problem” – powiedziała firma.