Blisko trzy czwarte Polaków uważa, że GenAI może pomóc firmom ulepszyć produkty i usługi

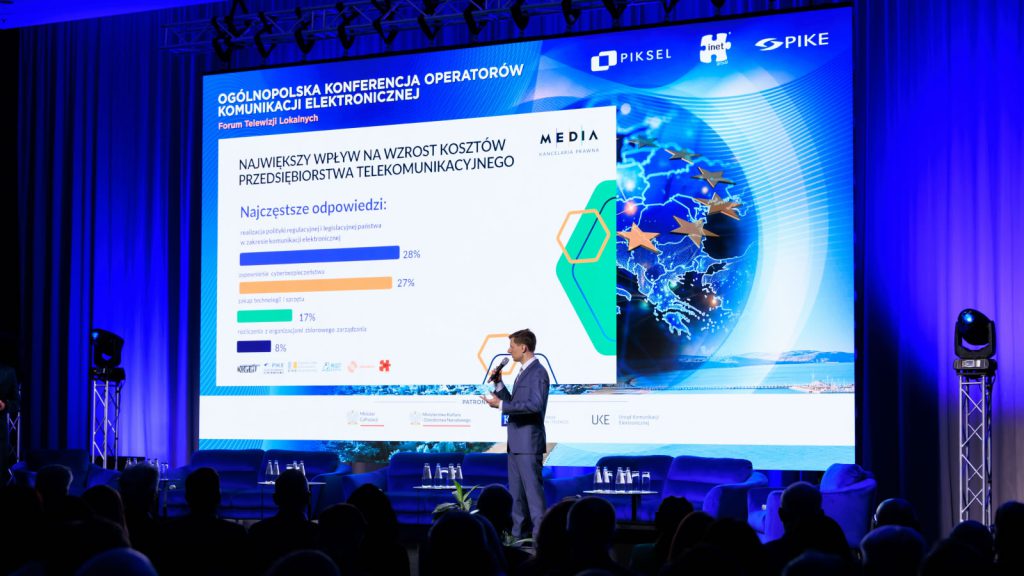

Rynek generatywnej AI w Europie rozwija się w szybkim tempie, jednak aby w pełni wykorzystać nowe możliwości, konieczne jest zbudowanie zaufania do tej technologii. Jak wynika z raportu firmy doradczej Deloitte, choć 68 proc. respondentów wierzy, że GenAI poprawi doświadczenia związane z wykonywaną pracą, zaledwie 18 proc. stosuje ją w celach zawodowych. Jednocześnie tylko połowa badanych ufa, że zastosowanie AI będzie właściwie uregulowane przez prawodawcę i odpowiedzialnie wykorzystywane w biznesie. Kluczowe dla zbudowania tego zaufania są kwestie takie jak bezpieczeństwo danych, rola człowieka w procesie, przejrzystość działania algorytmów oraz pewność otrzymywanych wyników.

Postawy wobec GenAI w Polsce i Europie

Z jakich narzędzi korzystamy?

Podobną sytuację obserwujemy na polskim rynku, co z jednej strony bardzo wyraźnie pokazuje potrzebę uregulowania stosowania sztucznej inteligencji w firmach, a często wręcz strategicznego podejścia, a z drugiej – rozwijania własnych narzędzi dopasowanych do procesów biznesowych danej organizacji. Przejście z fazy eksperymentów do pełnego wdrożenia, wymaga doświadczenia, kompetencji i zaangażowania zespołu projektowego złożonego ze specjalistów z zakresu procesów biznesowych, technologii oraz prawa. W Polsce wiele przedsiębiorstw testuje rozwiązania AI, a coraz więcej organizacji przechodzi do wdrożeń na większą skalę. – zaznaczył Amadeusz Andrzejewski, partner, lider zespołu Data & AI w Polsce, Deloitte.

Budowa zaufania kluczem do sukcesu

Uzyskane wyniki pokazują pewną lukę w zaufaniu do generatywnej AI. Użytkownicy wydają się wykazywać większą otwartość na korzystanie z takich rozwiązań, gdy sami je stosują lub gdy dotyczy to zastosowań, które uznają za mniej ryzykowne. Uwydatnia to potrzebę priorytetowego traktowania przez firmy, organizacje i instytucje publiczne kwestii transparentności w zakresie wykorzystania AI, zapewnienia użytkownikom odpowiednich narzędzi i szkoleń oraz aktywnego podejścia do kwestii prywatności danych. – podkreślił Jan Michalski, partner, DCE GenAI Market Activation Leader w Deloitte.

Nowe regulacje wprowadzane na poziomie unijnym mogą odegrać kluczową rolę w zbudowaniu odpowiednich ram prawnych i zaufania, a w konsekwencji adopcji generatywnej AI. Biorąc pod uwagę szybki rozwój tej technologii oraz to, że część postanowień AI ACT zacznie obowiązywać już od 2 lutego 2025 r., firmy już teraz powinny przyjąć proaktywne podejście. Powinno ono uwzględniać m.in. klasyfikację wykorzystywanych systemów AI oraz dokładne zidentyfikowanie istniejących dokumentów, procesów i odpowiedzialności w tym obszarze. Ponadto, dostawcy systemów AI i przedsiębiorstwa je stosujące muszą zapewnić odpowiednie kompetencje zespołów korzystających ze sztucznej inteligencji. Oznacza to nie tylko potrzebę zrozumienia kwestii technicznych na etapie rozwoju systemów AI, ale także wymaga odpowiednich kompetencji związanych z wykorzystywaniem ich w organizacji – dodał Michał Mostowik, adwokat specjalizujący się w zakresie regulacji AI, Deloitte Legal.