AMD prezentuje Gaia – platformę open source do lokalnego uruchamiania LLM na PC

W odpowiedzi na rosnące zainteresowanie lokalnym uruchamianiem modeli językowych AMD ogłasza premierę Gaia – otwartoźródłowego projektu pozwalającego użytkownikom Windows na korzystanie z dużych modeli językowych AI (LLM) bez potrzeby połączenia z chmurą. Aplikacja oferuje pełne wsparcie dla procesorów Ryzen AI, ale działa także na sprzęcie innych producentów.

W dobie gwałtownego rozwoju sztucznej inteligencji i coraz większego zapotrzebowania na prywatność oraz szybkość działania, lokalne modele językowe (LLM) stają się atrakcyjną alternatywą dla rozwiązań chmurowych. AMD dołącza do tego trendu, przedstawiając Gaia – projekt umożliwiający uruchamianie LLM na dowolnym komputerze z systemem Windows.

Nowa alternatywa: Gaia i Lemonade SDK

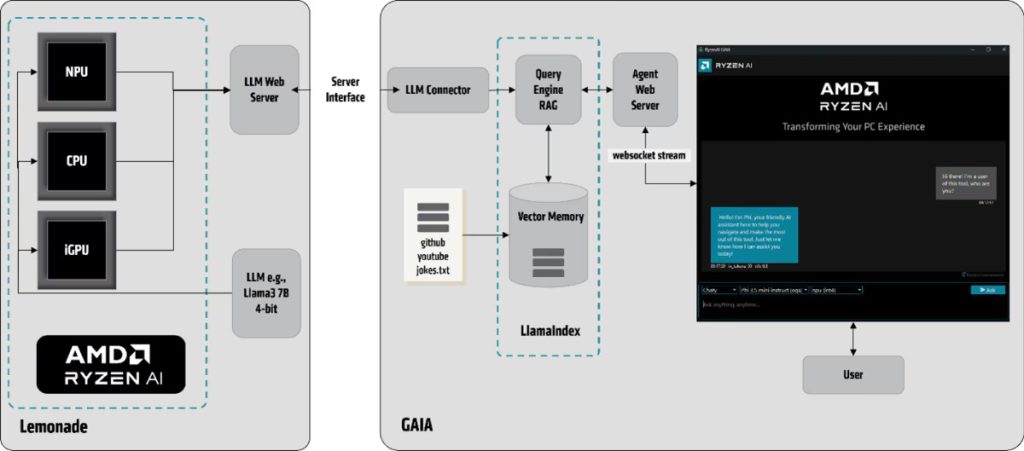

Gaia została zaprojektowana jako uniwersalne narzędzie do lokalnego uruchamiania modeli językowych, korzystające z open-source’owego zestawu narzędzi Lemonade SDK (od ONNX TurnkeyML). Dzięki niemu możliwe jest przeprowadzanie wnioskowania modeli LLM w różnych zastosowaniach – od generowania podsumowań po złożone analizy i rozumowanie kontekstowe.

Źródło: AMD

Gaia nie tylko uruchamia modele, ale potrafi również wzbogacać zapytania użytkownika poprzez tzw. Retrieval-Augmented Generation (RAG) – technikę łączącą model językowy z lokalną bazą wiedzy. Dzięki temu odpowiedzi są bardziej trafne i dopasowane do kontekstu.

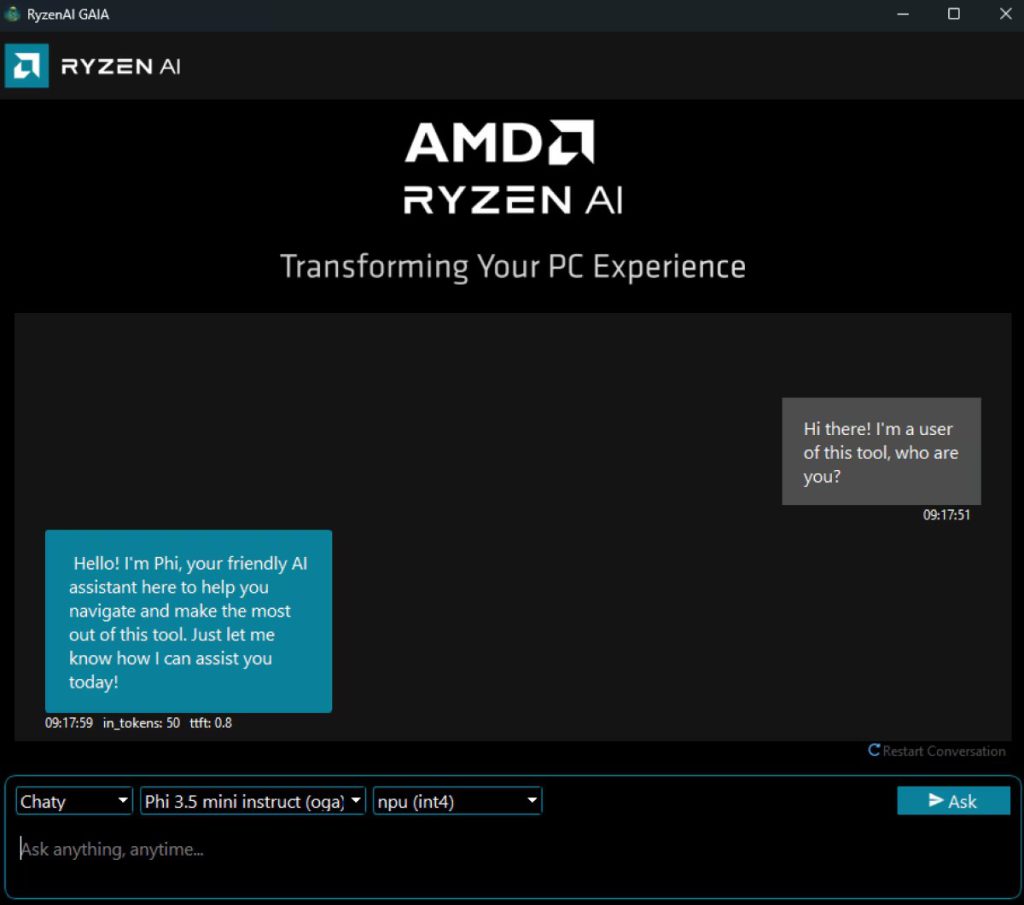

Cztery agenty AI w jednym pakiecie

Aplikacja Gaia oferuje cztery różne agenty:

- Simple Prompt Completion – do testów i ewaluacji modeli,

- Chaty – klasyczny chatbot do rozmowy z użytkownikiem,

- Clip – agent wyszukujący i odpowiadający na pytania związane z YouTube,

- Joker – generator żartów i humorystycznych odpowiedzi.

Każdy z nich działa w oparciu o lokalne dane, które Gaia potrafi przetwarzać i wektorować, np. z plików tekstowych, GitHuba czy filmów na YouTube, przechowując je w lokalnym indeksie wektorowym. Całość komunikuje się z aplikacją Gaia przez interfejs API kompatybilny z OpenAI, co ułatwia integrację z istniejącymi narzędziami.

Źródło: AMD

Dwie wersje instalatora: dla każdego i dla posiadaczy Ryzen AI

AMD przygotowało dwa rodzaje instalatorów Gaia: uniwersalny, który działa na każdym komputerze z Windows, oraz „Hybrid Installer” zoptymalizowany dla komputerów z procesorami Ryzen AI (np. Ryzen AI Max 395+). Wersja ta wykorzystuje neural processing unit (NPU) oraz zintegrowaną grafikę RDNA, co znacząco przyspiesza działanie modeli.

Gaia dołącza do rosnącego grona aplikacji umożliwiających lokalne uruchamianie modeli językowych, takich jak LM Studio czy ChatRTX od NVIDII. Zaletą takiego podejścia jest brak konieczności połączenia z Internetem, większa prywatność, niższe opóźnienia i pełna kontrola nad danymi użytkownika.

Eksperci podkreślają, że choć lokalne LLM-y nie zastąpią w pełni zaawansowanych usług chmurowych, to w wielu zastosowaniach – np. programowaniu, pracy z dokumentami czy edukacji – mogą oferować porównywalną jakość działania przy znacznie niższym ryzyku naruszenia prywatności.