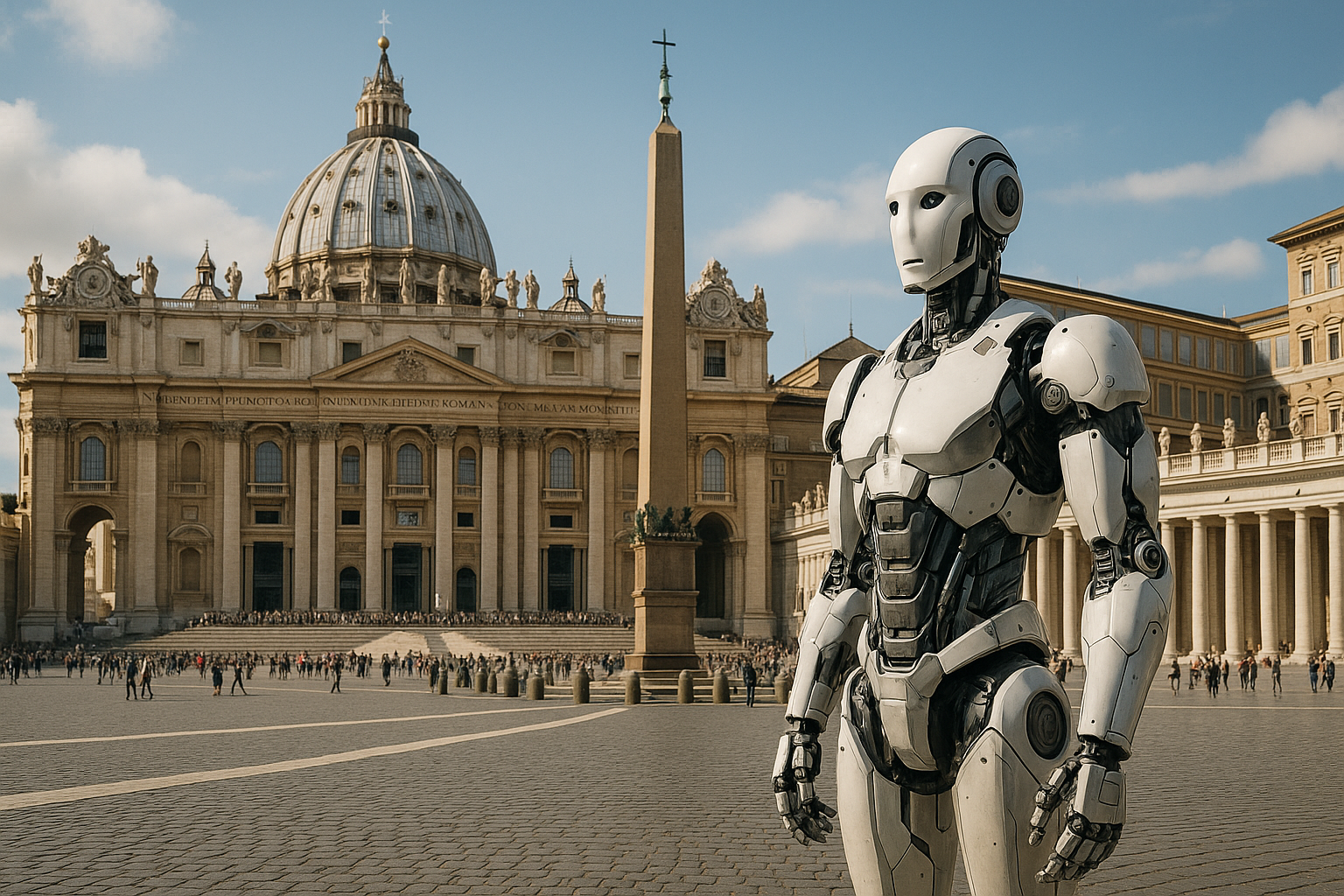

Liderzy Google, Microsoftu i Cisco w Watykanie – AI pod lupą papieża Leona XIV

W maju i czerwcu 2025 roku Watykan odwiedzili przedstawiciele Google, Microsoftu, Cisco, Meta, IBM i innych firm technologicznych. Tematem spotkań była etyka sztucznej inteligencji i podpisanie dokumentu Rome Call for AI Ethics.

Papież Leon XIV od początku swojego pontyfikatu jasno wskazuje, że rozwój sztucznej inteligencji to jedno z największych wyzwań współczesności. Podkreśla, że AI niesie ze sobą ogromny potencjał, ale jednocześnie stawia przed ludzkością poważne zagrożenia dla godności człowieka, sprawiedliwości społecznej i pracy. Papież widzi rolę Kościoła jako moralnego przewodnika, który musi pilnować, by postęp technologiczny służył wszystkim, a nie tylko wybranym.

Inspirując się pontyfikatem Leona XIII, który w czasach rewolucji przemysłowej bronił praw pracowniczych, Leon XIV apeluje o globalne standardy etyczne, ochronę praw człowieka i odpowiedzialne wdrażanie nowych technologii. W swoich wystąpieniach ostrzega, że AI nie może zastępować człowieka, a Kościół powinien aktywnie uczestniczyć w debacie o jej przyszłości, oferując „skarbiec nauki społecznej” jako punkt odniesienia dla świata technologii.

W związku ze stanowiskiem papieża, w maju i czerwcu 2025 roku Watykan odwiedzili przedstawiciele firm takich jak Google, Microsoftu, Cisco, Meta czy IBM. Tematem spotkań było nic innego, jak właśnie etyka sztucznej inteligencji i podpisanie dokumentu Rome Call for AI Ethics.

24 kwietnia 2024 roku dokument podpisało Cisco. W kolejnych tygodniach do grona sygnatariuszy dołączyły Meta i Anthropic. Dokument zobowiązuje firmy do rozwijania AI w sposób transparentny, odpowiedzialny i bezpieczny dla użytkowników. Powstał on w 2020 roku z inicjatywy Papieskiej Akademii Życia, Microsoftu, IBM i włoskiego rządu. Jego celem jest ochrona praw człowieka i promowanie etycznych zasad w cyfrowym świecie.

Wszystkie firmy, które podpisały Rome Call for AI Ethics, zobowiązały się do wdrażania sześciu kluczowych zasad w swoich działaniach związanych z rozwojem i wdrażaniem AI:

- Transparentność – AI musi być zrozumiała i wyjaśnialna dla użytkowników oraz regulatorów.

- Inkluzywność – Systemy AI nie mogą nikogo dyskryminować, mają służyć wszystkim, niezależnie od pochodzenia, statusu czy przekonań.

- Odpowiedzialność – Za każdą decyzję podejmowaną przez AI musi odpowiadać człowiek lub konkretna instytucja.

- Bezstronność – Algorytmy nie mogą wzmacniać uprzedzeń ani prowadzić do niesprawiedliwości.

- Niezawodność – AI powinna działać przewidywalnie i zgodnie z założeniami, minimalizując ryzyko błędów.

- Bezpieczeństwo i prywatność – Systemy muszą chronić dane użytkowników i zapewniać bezpieczeństwo informacji.

W połowie maja 2025 roku z papieżem Leonem XIV spotkał się z kolei Brad Smith, prezes Microsoftu. Rozmowy dotyczyły wyzwań związanych z rozwojem sztucznej inteligencji i konieczności wprowadzenia globalnych standardów etycznych. Dzień później swoje stanowiska w sprawie odpowiedzialnego wdrażania AI przedstawiła delegacja Google. Przedstawiciele firmy zgodnie argumentowali, że technologia powinna wspierać edukację i zdrowie, ale nie może prowadzić do marginalizacji ludzi.

Na czerwiec tego roku Watykan zorganizował kolejne konsultacje z ekspertami AI i etyki. Skupią się na wypracowaniu globalnych standardów etycznych oraz praktycznych wytycznych dla firm technologicznych, instytucji publicznych i społeczeństwa obywatelskiego. Omawiane będą zasady transparentności, odpowiedzialności i bezstronności w projektowaniu algorytmów oraz sposoby zapewnienia, by systemy AI nie prowadziły do dyskryminacji czy uprzedzeń. Uczestnicy przeanalizują wpływ AI na prawa człowieka, w tym ochronę prywatności i autonomii decyzyjnej, a także wyzwania związane z automatyzacją pracy i rolą edukacji w przygotowaniu społeczeństwa do nowych technologii.