Microsoft zadba o prywatne dane przetwarzane przez AI

Podczas tegorocznej konferencji Ignite w Seattle, Microsoft zapowiedział ponad 100 nowości, z czego większość wykorzystuje możliwości, jakie daje rozwój sztucznej inteligencji. Wszystkie narzędzia oczywiście powstają z zachowaniem odpowiedniej ostrożności. Microsoft zdaje sobie sprawę, że tak potężne narzędzia wykorzystujące dane użytkowników wymagają specjalnej ochrony, zarówno ze strony oprogramowania jak i hardware’u.

Rozwój AI to też kwestie związane z odpowiednim zabezpieczeniem danych. Aby wykorzystać w pełni możliwości chmury obliczeniowej, przy jednoczesnym zachowaniu bezpieczeństwa poufnych informacji, Microsoft we współpracy z Nvidią opracował rozwiązanie wykorzystujące szyfrowanie zarówno po stronie maszyny wirtualnej, układu obliczeniowego, jak i w komunikacji pomiędzy obiema warstwami. Prywatne maszyny wirtualne będą działały z procesorami graficznymi H100 Tensor Core, a także z układami AMD EPYC 4 generacji.

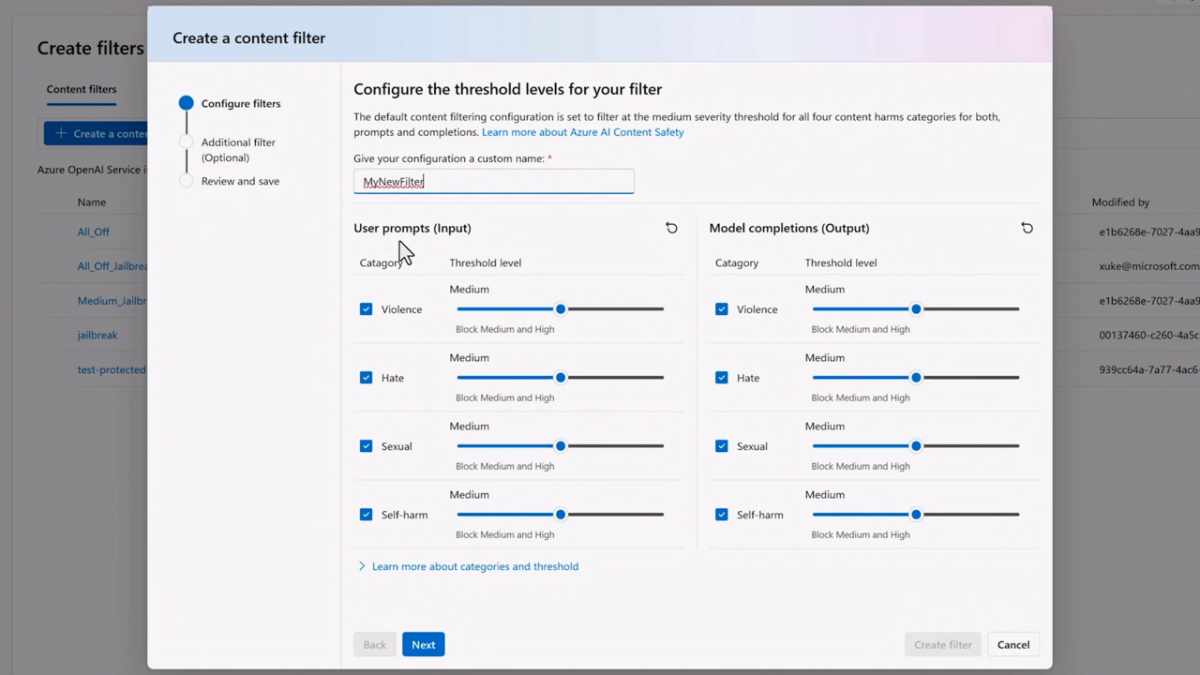

Twórcy oprogramowania będą mieli większą kontrolę nad zachowaniem AI (graf. Microsoft)

Twórcy oprogramowania w Azure AI Studio będą mogli dostosować model do swoich potrzeb, biorąc pod uwagę różne poziomy zabezpieczeń związanych zarówno z danymi wprowadzanymi przez użytkownika, a także z poziomem “wulgarności” odpowiedzi generowanych przez model. Wszystko to za pomocą łatwych w obsłudze filtrów, regulowanych za pomocą odpowiednich suwaków. Dzięki temu budując firmowego czatbota nie będziemy musieli się obawiać, że narzędzie zostanie użyte w niewłaściwym celu przez użytkownika końcowego, co widzieliśmy na przykładzie wczesnych wersji ChatuGPT.