Nocna spowiedź u chatbota. Microsoft ujawnia, o co pytamy AI o 3:00 nad ranem

Kiedy gaśnie światło, kończą się pytania o kod i Excela, a zaczynają rozmowy o sensie życia. Analiza 37,5 miliona konwersacji z Copilotem przeprowadzona przez badaczy Microsoftu pokazuje zaskakujący – ale zarazem bardzo ludzki – rytm naszych relacji ze sztuczną inteligencją. Okazuje się, że w erze cyfrowej „ciemna noc duszy” ma swojego nowego powiernika.

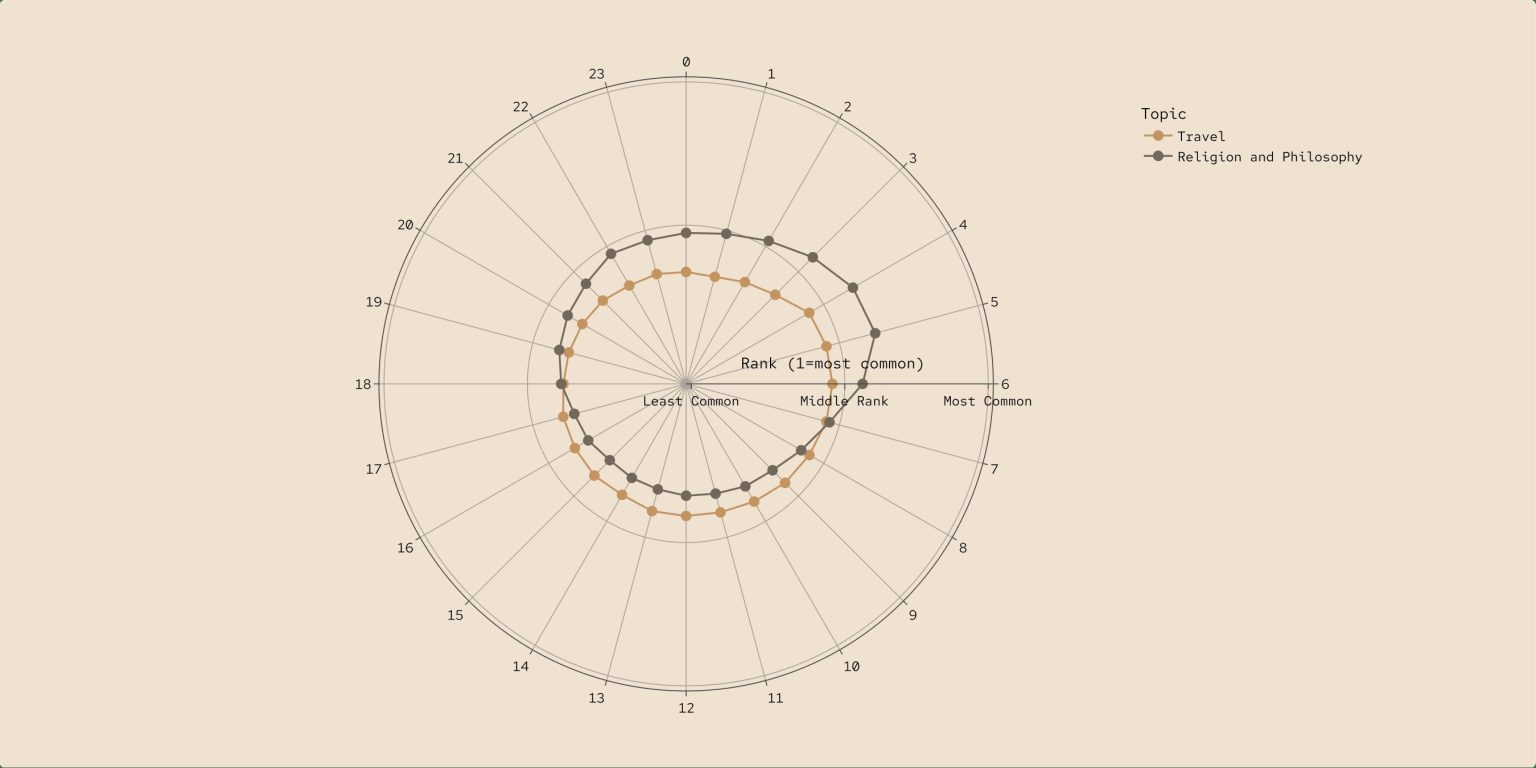

Badanie przeprowadzone przez zespół Microsoft AI odsłoniło wyraźny podział dobowy w sposobie, w jaki korzystamy z asystentów. W ciągu dnia, a zwłaszcza w godzinach dojazdów do pracy, dominują zapytania pragmatyczne – planowanie podróży, logistyka i zadania zawodowe. Jednak gdy zapada noc, a zegar wybija godzinę trzecią nad ranem, statystyki zapytań o religię i filozofię gwałtownie szybują w górę. Algorytm, który za dnia jest narzędziem produktywności, nocą staje się partnerem do egzystencjalnych rozważań, zastępując rozmowę z przyjacielem czy bezsenną gonitwę myśli.

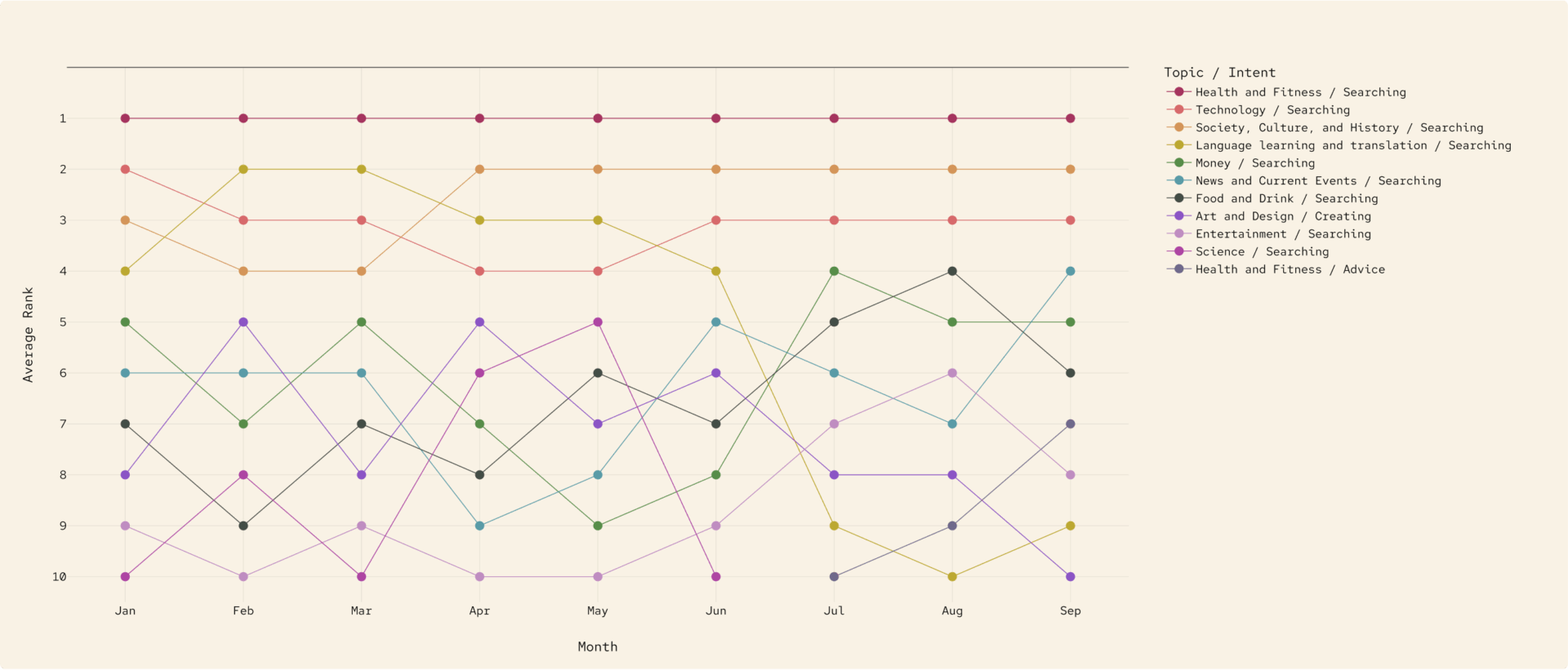

Analiza ujawniła ponadto, jak mocno nasze interakcje z AI są skorelowane z kalendarzem społecznym i kulturowym. W Walentynki odnotowano wyraźny skok rozmów dotyczących relacji, co potwierdza, że sztuczna inteligencja coraz częściej wchodzi w rolę konsultanta ds. emocji i życia prywatnego. Zmienia się też charakter zapytań – z prostego wyszukiwania informacji („search”) przesuwamy się w stronę szukania rady („advice”). Użytkownicy coraz śmielej proszą algorytmy o opinie w sprawach osobistych, co stawia przed twórcami modeli zupełnie nowe wyzwania etyczne. Skoro AI staje się nocnym terapeutą i doradcą życiowym, jakość i bezpieczeństwo generowanych przez nią odpowiedzi przestają być kwestią techniczną, a stają się problemem społecznym.

Wnioski z raportu Microsoftu są jasnym sygnałem, że AI przestała być już tylko technologiczną nowinką, a stała się elementem naszej (także psychologicznej) codzienności. Rytm rozmów z Copilotem – od kodowania w tygodniu, przez gaming w weekendy, aż po nocne filozofowanie – idealnie odwzorowuje ludzkie potrzeby. Jednak ten rosnący poziom zaufania, jakim obdarzamy algorytmy w naszych najbardziej wrażliwych momentach, nakłada gigantyczną odpowiedzialność na dostawców (i regulatorów) technologii. Skoro użytkownicy wyraźnie traktują AI jak powiernika i doradcę w kryzysie, systemy te nie powinny być projektowane wyłącznie pod kątem wydajności czy zysku. Bo błąd lub halucynacja modelu o 3:00 nad ranem może mieć znacznie poważniejsze skutki niż pomyłka w Excelu.