Nowe zasady dla AI w USA. Priorytetem innowacja i przewaga nad Chinami

Administracja USA przedstawiła długo oczekiwane ramy legislacyjne dla sztucznej inteligencji. Dokument ma uporządkować podejście do regulacji i jednocześnie ograniczyć inicjatywy stanowe. W praktyce oznacza to próbę przyspieszenia rozwoju AI przy minimalnym poziomie nadzoru.

Nowe ramy regulacyjne opublikowane przez Biały Dom są rozwinięciem rozporządzenia wykonawczego podpisanego w grudniu przez prezydenta Donalda Trumpa. Dokument zakłada ograniczenie możliwości wprowadzania odrębnych regulacji przez poszczególne stany i przeniesienie ciężaru legislacyjnego na poziom federalny.

Administracja wskazuje, że obecna fragmentacja przepisów może spowalniać rozwój technologii oraz osłabiać konkurencyjność Stanów Zjednoczonych wobec Chin. W odpowiedzi proponuje zestaw sześciu celów dla Kongresu, które mają pogodzić szybki rozwój AI z budowaniem zaufania społecznego.

Krajowe ramy legislacyjne dla AI uwolnią amerykańską innowacyjność i pozwolą wygrać globalny wyścig technologiczny, tworząc miejsca pracy i obniżając koszty – podkreślił Michael Kratsios, doradca prezydenta ds. nauki i technologii.

Kluczowe założenia, infrastruktura, treści i bezpieczeństwo

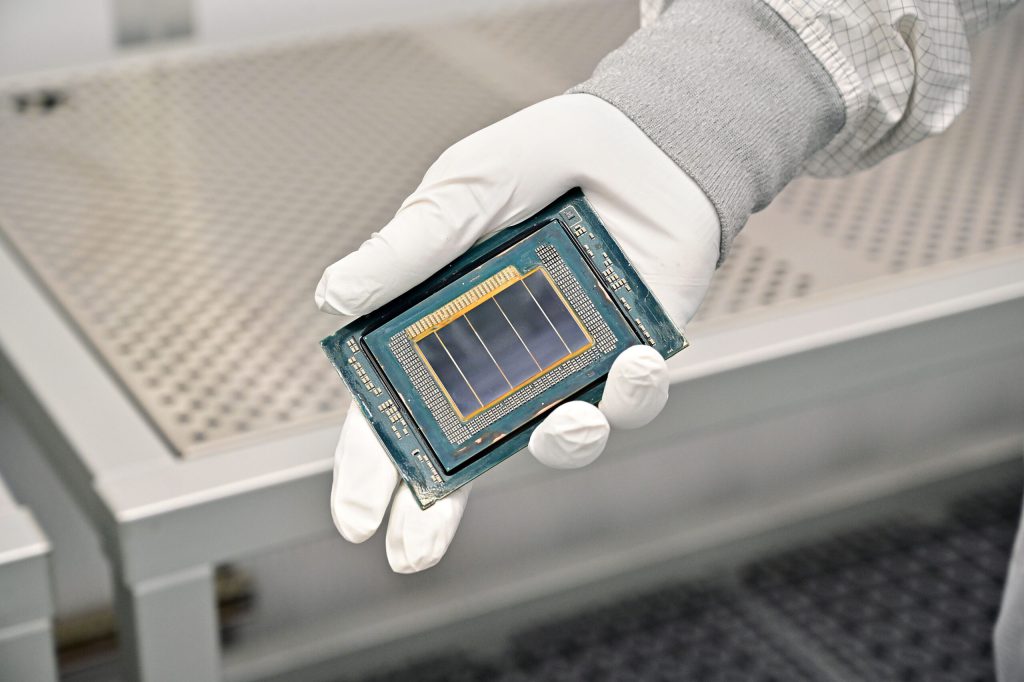

Propozycja obejmuje szerokie spektrum zagadnień, od infrastruktury centrów danych po walkę z oszustwami wykorzystującymi AI. Jednym z priorytetów jest uproszczenie procedur związanych z budową centrów danych, w tym umożliwienie im wytwarzania energii na miejscu.

Administracja chce także wzmocnić narzędzia dla rodziców do kontroli aktywności dzieci w środowisku cyfrowym oraz doprecyzować zasady dotyczące wykorzystania treści objętych prawem autorskim w procesie trenowania modeli.

Istotnym elementem jest również zapis dotyczący ograniczenia wpływu rządu na moderację treści. W dokumencie pojawia się postulat, aby administracja federalna nie mogła wymuszać na firmach technologicznych zmian treści z powodów ideologicznych lub politycznych. Zamiast jednego centralnego regulatora AI, Biały Dom proponuje podejście sektorowe. Oznacza to, że nadzór nad wykorzystaniem technologii miałby być realizowany przez istniejące organy regulacyjne, zależnie od branży.

Spór o odpowiedzialność i tempo regulacji

Propozycja spotkała się z mieszanymi reakcjami. Zwolennicy liberalnego podejścia wskazują, że jasne zasady na poziomie federalnym mogą ułatwić rozwój innowacji. Collin McCune z funduszu Andreessen Horowitz określił projekt jako „duży krok” w kierunku stworzenia przewidywalnego środowiska dla firm technologicznych.

Krytycy zwracają jednak uwagę na brak mechanizmów odpowiedzialności. Brendan Steinhauser z organizacji Alliance for Secure AI ocenił, że dokument nie daje realnych narzędzi do egzekwowania odpowiedzialności za szkody wyrządzane przez AI. Podobne stanowisko przedstawił też Brad Carson z Public First Action, wskazując, że propozycja przypomina podejście znane z początków mediów społecznościowych, gdzie regulacje były minimalne, a skutki ujawniły się dopiero po latach.