TrendForce: popyt na platformę Blackwell firmy NVIDIA zwiększy łączną wydajność CoWoS TSMC o ponad 150% w 2024

Platforma Blackwell nowej generacji firmy NVIDIA, która obejmuje procesory graficzne z serii B i integruje własny procesor NVIDIA Grace Arm w modelach takich jak GB200, stanowi znaczący postęp.

Jak wskazuje TrendForce, zarówno GB200, jak i jego poprzednik, GH200, oferują połączone rozwiązanie CPU+GPU, wyposażone głównie w procesor NVIDIA Grace i procesor graficzny H200. Jednak GH200 stanowił jedynie około 5% dostaw wysokiej klasy procesorów graficznych NVIDIA. Łańcuch dostaw ma duże oczekiwania co do GB200, a prognozy sugerują, że dostawy mogą przekroczyć miliony jednostek do 2025 roku, co potencjalnie będzie stanowić prawie 40 do 50% rynku wysokiej klasy procesorów graficznych NVIDIA.

Chociaż NVIDIA planuje wprowadzić na rynek takie produkty, jak GB200 i B100 w drugiej połowie tego roku, w branży opakowań wafli wyższego szczebla konieczne będzie zastosowanie bardziej złożonej i precyzyjnej technologii CoWoS-L, co sprawi, że proces walidacji i testowania będzie czasochłonny. Ponadto optymalizacja serii B pod kątem systemów serwerów AI w takich aspektach, jak komunikacja sieciowa i wydajność chłodzenia, będzie wymagała więcej czasu.

Przewiduje się, że znaczące wolumeny produkcji produktów GB200 i B100 zostaną osiągnięte dopiero w IV kw. 2024 lub 1 kw. 2025 r. Włączenie GB200, B100 i B200 do serii B firmy NVIDIA zwiększy popyt na pojemność CoWoS, co skłoniło TSMC do zwiększenia całkowitego zapotrzebowania na pojemność CoWoS na rok 2024.

Oczekuje się, że szacunkowa miesięczna wydajność do końca roku osiągnie prawie 40 tys. — wzrost aż o 150% rok do roku. Do 2025 roku planowana łączna moc obliczeniowa może się prawie podwoić, a zapotrzebowanie firmy NVIDIA ma stanowić ponad połowę tej wydajności.

Inni dostawcy, tacy jak Amkor i Intel, obecnie skupiają się na technologii CoWoS-S i obierają za cel przede wszystkim serię H firmy NVIDIA. Biorąc pod uwagę, że przełomy technologiczne będą stanowić wyzwanie w perspektywie krótkoterminowej, plany ekspansji pozostaną konserwatywne, chyba że dostawcy ci będą w stanie pozyskać dodatkowe zamówienia poza firmą NVIDIA, takie jak samodzielnie opracowane chipy ASIC przez dostawców CSP, co może prowadzić do bardziej agresywnej strategii ekspansji.

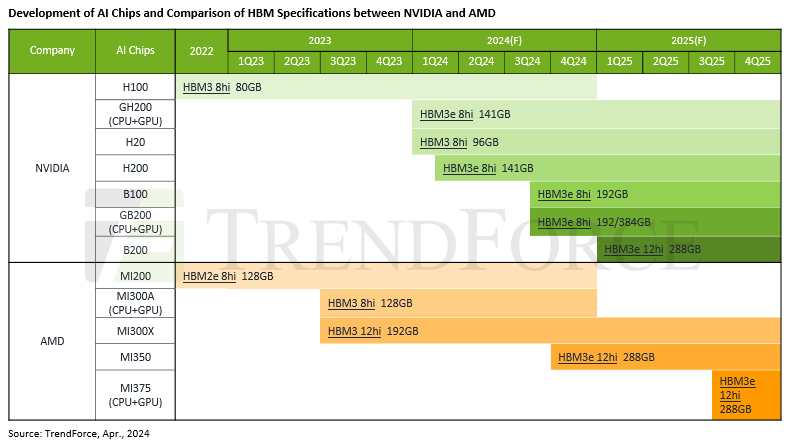

Rozwój sztucznej inteligencji NVIDIA i AMD ma zapewnić HBM3e dominację na głównym rynku do drugiej połowy roku Firma TrendForce zidentyfikowała trzy główne trendy HBM dla głównych produktów GPU NVIDIA i AMD oraz ich specyfikacji planowanych na okres po roku 2024.

Po pierwsze, przewidywane jest przejście z HBM3 na HBM3e. Oczekuje się, że NVIDIA rozpocznie zwiększanie dostaw H200 wyposażonego w HBM3e w drugiej połowie 2024 roku, zastępując H100 jako główny model. Następnie inne modele, takie jak GB200 i B100, również zostaną wyposażone w HBM3e.

Tymczasem AMD planuje wypuszczenie nowego MI350 do końca roku i może w międzyczasie wprowadzić modele tymczasowe, takie jak MI32x, które będą konkurować z H200, przy czym oba będą wykorzystywać HBM3e.

Po drugie, będzie kontynuowany rozwój wydajności HBM w celu zwiększenia ogólnej wydajności obliczeniowej i przepustowości systemu serwerów AI. Na rynku obecnie wykorzystuje się głównie kartę NVIDIA H100 z 80 GB pamięci HBM, której pojemność ma wzrosnąć do końca 2024 r. do 192–288 GB. Nowe procesory graficzne AMD, począwszy od 128 GB MI300A, również odnotują wzrost, osiągając 288 GB.

Po trzecie, oferta procesorów graficznych wyposażonych w HBM3e będzie ewoluować od konfiguracji 8Hi do konfiguracji 12Hi. Modele B100 i GB200 firmy NVIDIA są obecnie wyposażone w 8Hi HBM3e o pojemności 192 GB, a do 2025 roku model B200 ma zostać wyposażony w 12Hi HBM3e, osiągając 288 GB.

Oczekuje się, że nadchodzące modele AMD MI350, które zostaną wprowadzone na rynek pod koniec tego roku, oraz seria MI375, której premiera planowana jest na rok 2025, będą wyposażone w pamięć 12Hi HBM3e, również o pojemności 288 GB.