Skalowanie AI bez przebudowy centrów danych dzięki nowym układom AMD Instinct MI350P

AMD wprowadza na rynek akceleratory Instinct MI350P w formacie PCIe. Rozwiązanie to pozwala na instalację kart bezpośrednio w standardowych serwerach chłodzonych powietrzem bez przebudowy szaf rack. Dzięki temu przedsiębiorstwa mogą wdrażać zaawansowane wnioskowanie AI przy zachowaniu pełnej kontroli nad kosztami i bezpieczeństwem danych wewnątrz własnej infrastruktury.

Charakterystyka techniczna i cel wdrożenia

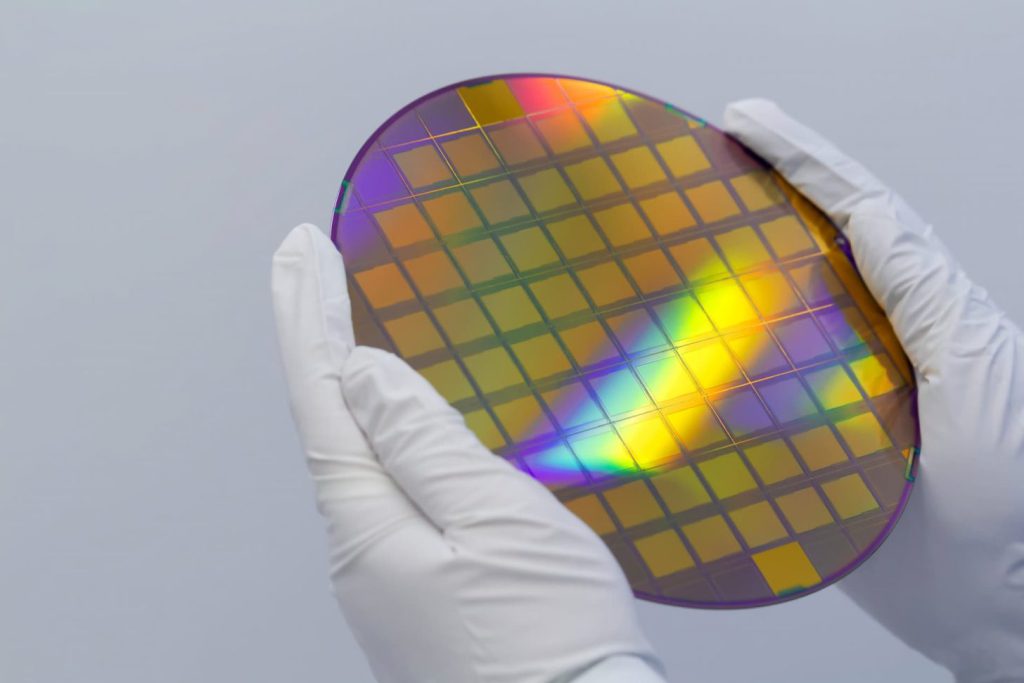

Układy Instinct MI350P PCIe wypełniają lukę między procesorami ogólnego przeznaczenia a dedykowanymi platformami akceleracyjnymi. Są to dwuslotowe karty zaprojektowane do szybkiej implementacji w posiadanych już przez firmy centrach danych. Wykorzystanie standardowego chłodzenia powietrzem usuwa przeszkody inwestycyjne związane z koniecznością modernizacji systemów klimatyzacji i zasilania. Rozwiązanie to adresuje potrzeby podmiotów, które rezygnują z chmury publicznej na rzecz bardziej przewidywalnych modeli kosztowych on-premises.

Wydajność w kontekście rynkowym

Moc obliczeniowa jednostki wynosi 2 299 teraflopsów przy standardowych obciążeniach korporacyjnych. W formacie MXFP4 wydajność szczytowa wzrasta do 4 600 TFLOPS, co pozycjonuje produkt jako najwydajniejszą obecnie kartę PCIe dla sektora przedsiębiorstw. Pamięć HBM3E o pojemności 144 GB zapewnia przepustowość danych na poziomie 4 terabajtów na sekundę. Sprzęt ten pojawia się na rynku w momencie masowego przechodzenia organizacji od fazy eksperymentalnej do produkcyjnego wdrażania agentów AI.

AMD wprowadza na rynek akceleratory Instinct MI350P PCIe, które pozwalają na skalowanie operacji AI wewnątrz standardowych centrów danych bez konieczności inwestowania w kosztowną modernizację infrastruktury energetycznej i chłodniczej.

Skutki dla ekosystemu IT

Partnerzy sprzętowi, w tym Dell, HPE oraz Lenovo, zadeklarowali wsparcie dla nowych układów w swoich portfolio serwerowych. David Schmidt z Dell Technologies ocenia, że lokalna infrastruktura staje się realną przewagą konkurencyjną pod względem bezpieczeństwa i stabilności wyników. Obsługa otwartego standardu ROCm umożliwia programistom migrację obciążeń bez kosztownego przepisywania kodu źródłowego aplikacji. Integracja z platformą VMware Cloud Foundation ułatwia natomiast zarządzanie mocą obliczeniową GPU w ramach istniejących struktur wirtualnych.